RWKV新架构概览

随着人工智能技术的不断进步,RWKV系列作为国产新兴技术的代表,近期发布了Eagle(RWKV-5)和Finch(RWKV-6)两款新型架构模型。这两款基于RWKV-4的改进版本,在结构和机制上均有显著提升,不仅增强了模型的表达力,还维持了RNN独有的高效推理特性。

技术细节和创新点

Eagle模型

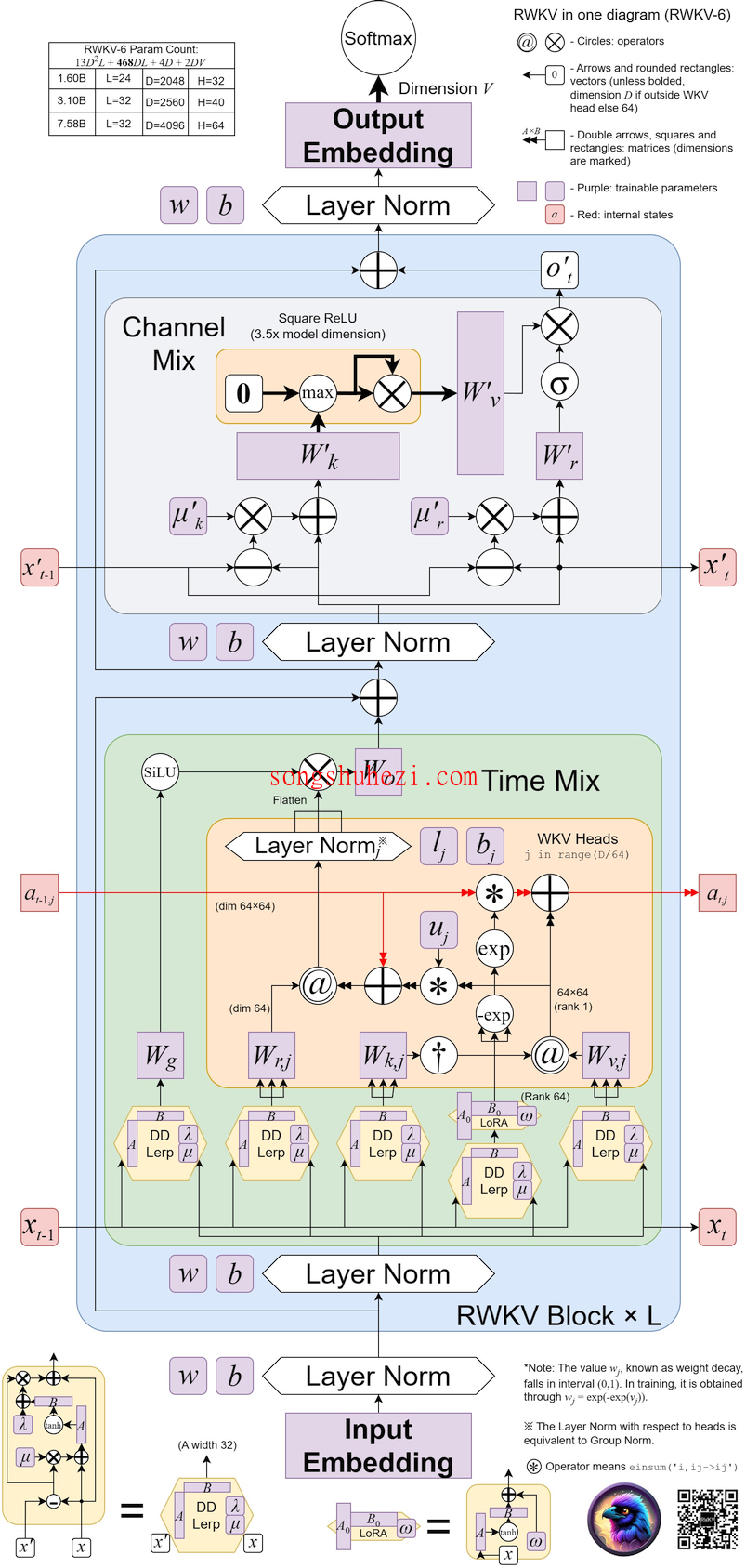

Eagle模型通过采用多头矩阵值状态代替传统的向量值状态,增强了数据处理的维度和灵活性。此外,Eagle还重新设计了接受态结构,并引入了额外的门控机制,这些优化使得模型在处理长序列数据时更为高效。

Finch模型

Finch模型则在数据处理功能上做了进一步的创新,通过引入新的数据相关函数,增强了模型对时间序列的处理能力。此外,Finch还采用了低秩自适应函数,使得模型在各种语境下都能更好地理解和适应数据变化。

多语言性能和应用

RWKV新架构特别强调多语言处理能力,发布了包含1.12万亿令牌的RWKV World v2多语言数据集。这一数据集的构成复杂,包括大量英语、多语言及代码数据,为模型的多语言理解和应用提供了丰富的训练材料。

此外,RWKV团队还开发了一种新的基于Trie的贪婪匹配分词器,该分词器特别适合处理非主流语言,有效提高了模型在全球范围内的适用性和精确度。

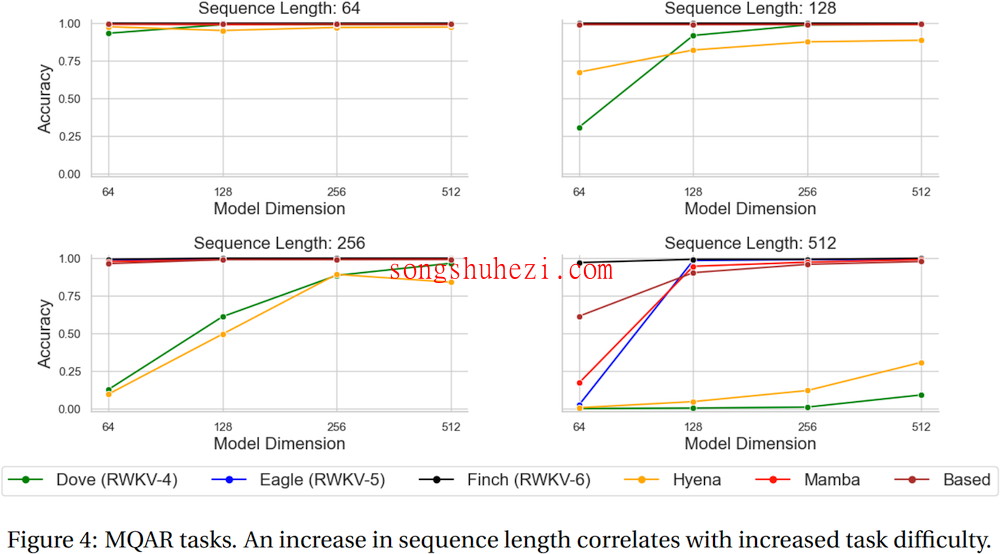

在MQAR和PG19等权威评测中,新架构模型展现出优于前代及其他非Transformer架构的性能,尤其在长上下文任务和多语言任务中表现突出。

从技术细节到模型表现,Eagle和Finch都显示出了非常引人注目的特点和潜力。Eagle模型在长文本的理解和生成上,明显优于以往的模型,而Finch在灵活应对不同数据类型上的表现,则大大超出我的预期。这些优化不仅使得模型的适用范围更广,也极大地提升了开发效率和应用的实际效果。