Baize是一个开源的聊天模型,采用LoRA技术进行训练,其数据来源包括100k对话,这些对话是通过让ChatGPT与自身对话生成的。Baize项目利用Alpaca的数据来提升模型性能,目前已发布7B、13B和30B三种模型规格。

Baize命名的寓意

Baize在中文传说中是一种通人语、晓天地的神兽,这正体现了Baize聊天模型的设计初衷——能够理解和生成人类语言,洞察各种对话情境。

核心特性

Baize模型具备以下几个特点:

- 开源与共享:代码和模型权重仅供研究使用,严禁商业用途,确保技术的开放性和高透明度。

- 多语言数据集:除了英文数据外,Baize还处理多语言和代码数据,支持多样化的语言环境。

- 模型适应性强:通过在各种对话场景中进行自我对话的方式训练,Baize能够适应各种复杂的对话环境。

如何应用

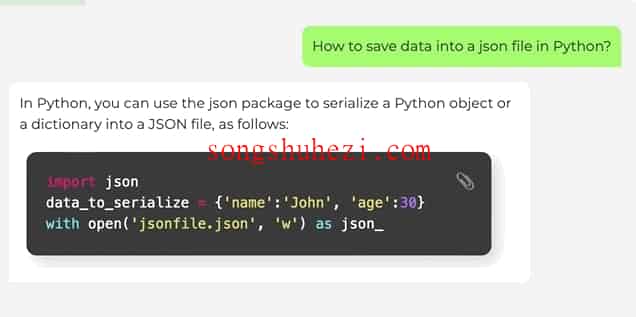

用户可以通过以下方式使用Baize模型:

-

CLI和API支持:通过Fastchat的CLI和API,用户可以轻松集成和使用Baize模型。

-

本地部署:

-

首先,确保您的Python版本是3.8,然后使用以下命令安装所需的包:

cd demo pip install -r requirements.txt您可以使用以下命令在本地计算机上托管模型:

# We assume you have obtained access to use LLaMA. The following LLaMA weights are from a 3rd party. base_model=huggyllama/llama-7b lora_model=project-baize/baize-lora-7B python app.py $base_model $lora_model对于 v2 模型(已合并),只需运行:

# We assume you have obtained access to use LLaMA. base_model=project-baize/baize-v2-7b python app.py $base_model None

从数据收集到模型训练,Baize项目展示了其在处理多语言对话方面的强大能力。特别是其开源的策略和广泛的应用前景,让我们可以更深入地了解和利用这一技术。