MagicAvatar由字节跳动开发,是一款主打多模态输入生成的多模态框架,可以将文本、视频和音频等不同输入方式转化为动作信号,从而生成和动画化一个虚拟人物。

了解更多:https://magic-avatar.github.io/

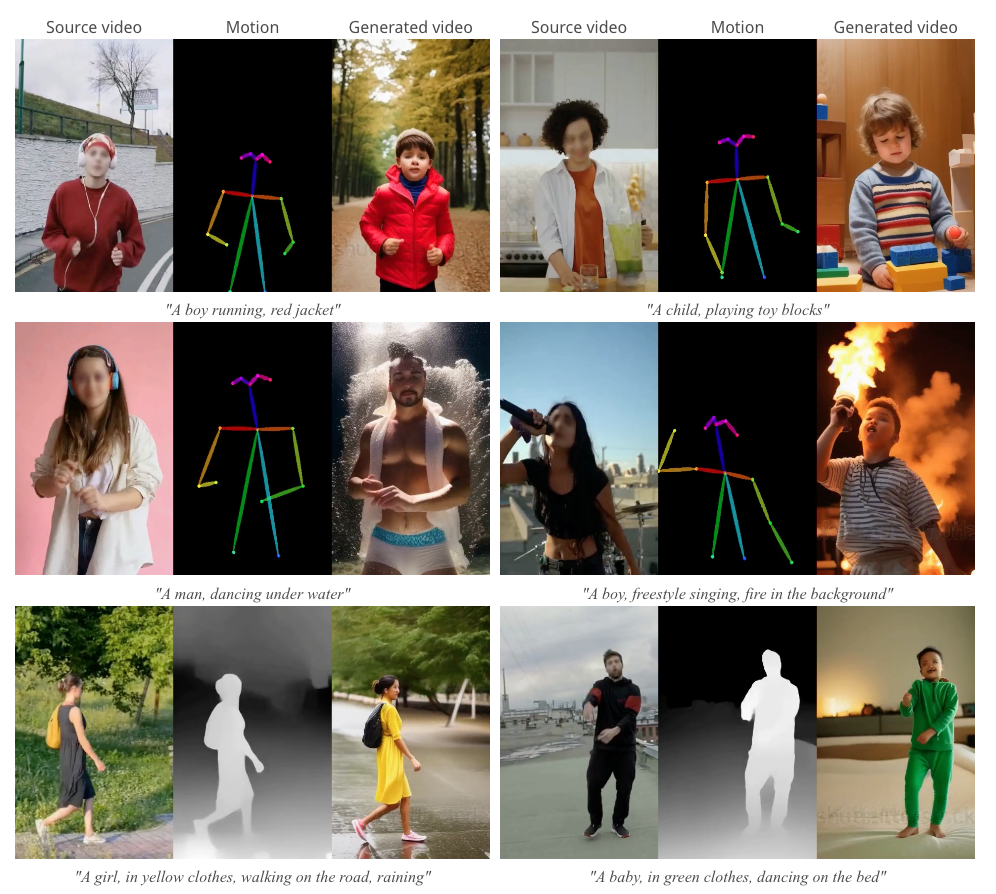

具体来说,通过简单的文本提示就能创建虚拟人物,也可以根据源视频生成跟随给定动作生产,还能对特定主题的虚拟人物进行动画化。

比如,输入“一个在火山里踢踏舞的宇航员”就能生成一个相应的虚拟形象。

或者直接提供一个源视频,然后AI就会创建一个跟随给定动作的形象。

根据字节团队的解释,相比以往直接从多模态输入生成视频,MagicAvatar独特之处主要是将视频生成明确分解为两个阶段。

第一阶段,主要将多模态输入(文本、视频、语音等)转换为表示运动的信号,如人体姿态、深度信息、DensePose等。第二阶段,则是将第一阶段生成的运动信号与外观描述一起输入到模型,然后生成视频。